不要被低价蒙蔽了双眼,3分钟教你如何判断中转站的实际价格

背景

首先感谢这个帖子开启了一个很有意思的话题,那就是中转站的价格是否是和他们宣传的一样便宜。https://linux.do/t/topic/459160

结论

凑巧这周二我也手动算了一圈27个中转站的实际价格。找到一些很有意思的结论:

- 大部分中转站的价格都非常乱,一般来说都是 有错有对的模型倍率 + 五花八门的分组倍率 + 充值汇率

- 有些商用中转站默认的模型价格就是错的,只要用默认就有问题,最明显的就是o1-mini / o3-mini 这两个,很多站点的价格是 1.5 倍,比官方定价贵大约3倍。

- 在发现问题后,可以尝试和商家进行沟通,一般来说小错误应该得到修正。商家不及时修正的后果可能是被挂在论坛上吊着打。https://linux.do/t/topic/366740

对于所有看到的帖子的中转站维护者,从简便计算和做大做强的角度应该这样做:

- 将自己的模型倍率对齐官方的价格。

- 价格波动可以依靠不同的分组倍率来调节。

- 充值汇率固定为1:1。

经验分享

计算公式

中转站的实际价格 = (模型倍率/官方标准倍率) * (分组倍率,没有就是1) * 充值汇率

举个例子,假如有一个叫 FakeAI 的中转站,他的充值汇率是1块钱等于1美元额度,o1-mini 模型倍率是 1.5倍且补全倍率和官方一致是4倍,分组"官转"的分组倍率是 2x。

那么对于 o1-mini 模型实际的价格就是 (1.5/0.55) * 2 * 1 = 5.45。也就是充值 5.45 元才能获得这个模型官方 1 美元的额度。

注:0.55是 o1-mini 模型的官方倍率,具体推算规则在下面。

关于模型倍率的概念

因为几乎所有的中转站都是 one-api 的某种分支。所以他们都集成了模型倍率这个屎山概念。

在早期,因为可以注册账号试用5美元 OpenAI 的 api额度,但有rpm的严格限制。刚开发的 one-api 很大一个功能就是把一堆试用账号攒起来混在一起用。

那时候的模型是 davinci-002。这个模型输入 1M tokens的价格是 $2.00,输出 1M tokens 的价格 $2.00。

one-api 基于某种简便计算的需要(?),创造了一个模型倍率的概念,设定1倍的模型倍率和 davinci-002 的输入输出价格一致。即 1M tokens 的价格为 $2.00。

相关讨论可以看这里:https://github.com/songquanpeng/one-api/issues/766

热门模型的倍率

几个热门模型的标准倍率应该是这样的:

| 模型 | 模型倍率 | 提示倍率 | 补全倍率 |

|---|---|---|---|

| gpt-4o-mini | 0.075 | 1 | 4 |

| gpt-4o | 1.25 | 1 | 4 |

| o1-mini | 0.55 | 1 | 4 |

| claude-3.5-sonnet | 1.5 | 1 | 5 |

| deepseek-r1 | 0.275 | 1 | 4 |

如何计算我用的模型的标准倍率应该是多少?

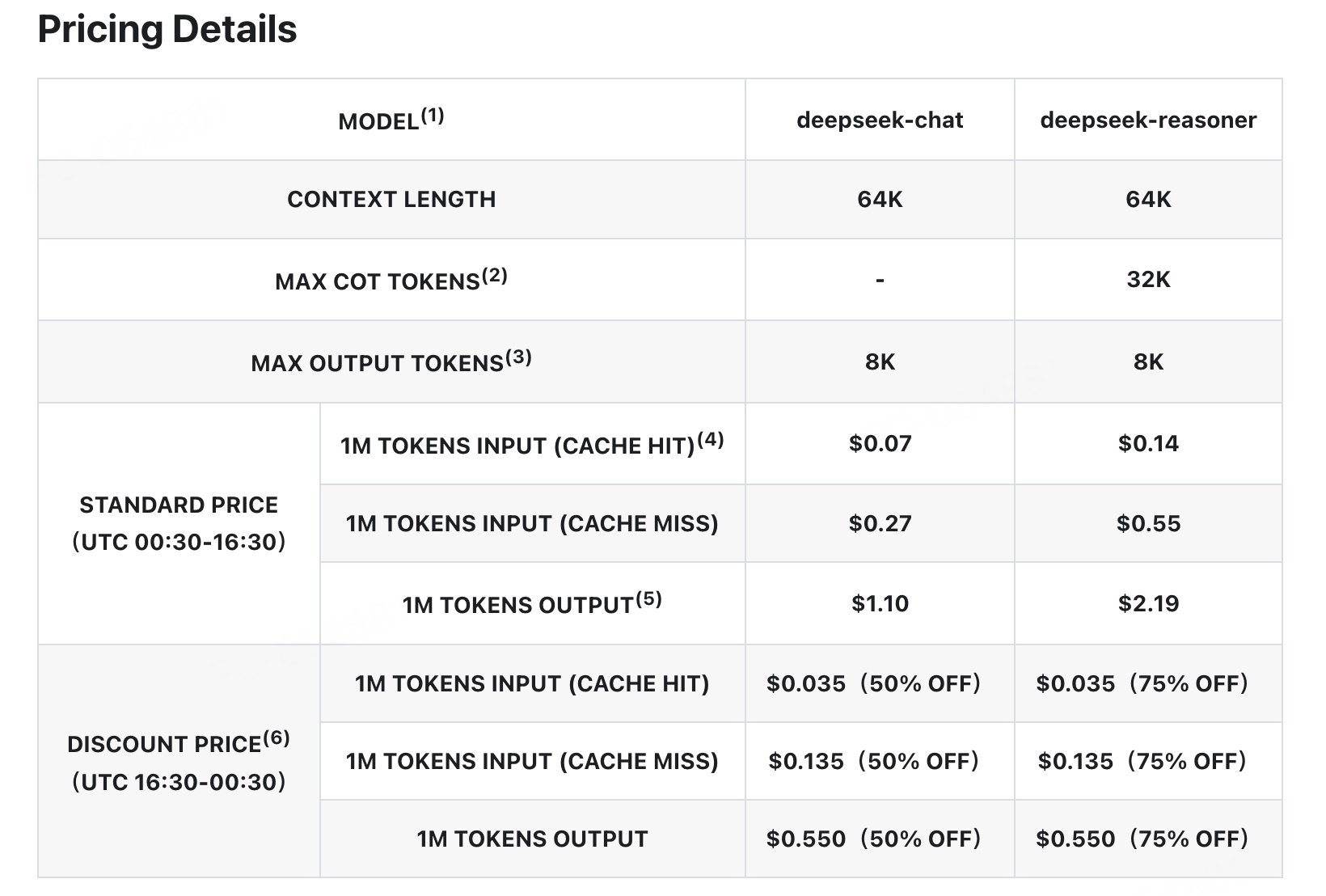

我们以高峰期的 deepseek r1 模型为例。以美元计价,在未命中缓存时输入 1M tokens的价格是 $0.55,输出 1M tokens的价格是 $2.19。

那么,deepseek r1的模型倍率 = deepseek-r1输入价格 $0.55 / davinci-002的输入价格 $2 = 0.275倍。

这个时候我们会注意到 输出 token 的价格比输入贵很多,那么输出比输入贵多少倍,就是补全倍率。

补全倍率 = deepseek-r1输入价格 $0.55 / deepseek-r1输出价格 $2.19 = 4倍。

来源:https://api-docs.deepseek.com/quick_start/pricing

我手动计算后27个中转站的实际价格

可以看这个:中转站竞技场